机构名称:

¥ 7.0

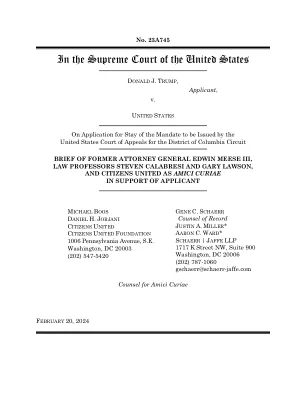

通过例如人工神经网络获得的预测具有很高的准确性,但人类通常将模型视为黑匣子。关于决策的见解对人类来说大多是不透明的。特别是了解医疗保健或金融等高度敏感领域的决策至关重要。黑匣子背后的决策需要它对人类更加透明、负责和易于理解。本调查论文提供了基本定义,概述了可解释的监督机器学习 (SML) 的不同原理和方法。我们进行了一项最先进的调查,回顾了过去和最近的可解释 SML 方法,并根据引入的定义对它们进行分类。最后,我们通过解释性案例研究说明原则并讨论重要的未来方向。

arXiv:2011.07876v1 [cs.LG] 2020 年 11 月 16 日

![arXiv:2011.07876v1 [cs.LG] 2020 年 11 月 16 日PDF文件第1页](/bimg/d/dbcae7994ff422929d3ecd2f24586c26bcfaef31.webp)

![arXiv:2011.07876v1 [cs.LG] 2020 年 11 月 16 日PDF文件第2页](/bimg/e/e893e2c47f871ee59a3d925f0b48e9840254b3a2.webp)

![arXiv:2011.07876v1 [cs.LG] 2020 年 11 月 16 日PDF文件第3页](/bimg/8/803ae469ccddbf62e616ac1ba33efcead6667981.webp)

![arXiv:2011.07876v1 [cs.LG] 2020 年 11 月 16 日PDF文件第4页](/bimg/c/c64cc4ee83e5fabee90a194240ecb43b5aba8d5e.webp)

![arXiv:2011.07876v1 [cs.LG] 2020 年 11 月 16 日PDF文件第5页](/bimg/5/5bb5e50a79dc3b05e8c097216c2164fa0ba12274.webp)

![arXiv:2011.07876v1 [cs.LG] 2020 年 11 月 16 日](/simg/6/68758036e90c90f3903356cd2f9a18d6db5b3ba4.webp)

![arXiv:2001.02021v1 [cs.AI] 2020 年 1 月 7 日](/simg/6/6656a65d1324b757699cd670b349c20ef6da7f31.png)

![arXiv:1105.1693v1 [cs.CY] 2011 年 5 月 9 日](/simg/1/13d5c100df3a4d517cdd2c9820dd75615590e86e.webp)

![arXiv:2003.05823v1 [cs.RO] 2020 年 3 月 12 日](/simg/c/cf9e39bb81ef86eb692012c7befa2c3c970b4e31.webp)

![arXiv:1901.02602v1 [cs.LG] 2019 年 1 月 9 日](/simg/0/04ec387a38e523020e6fffe3b65c786036aa678b.webp)

![arXiv:2001.07537v1 [cs.AI] 2020 年 1 月 21 日](/simg/9/9263a647ebe77a59e853ed496cc8cf75b3b255ec.png)

![arXiv:2007.10018v1 [cs.AI] 2020 年 7 月 20 日](/simg/3/3ea5103465cc9bd377356254235ee19fc60e3965.png)

![arXiv:1611.05449v2 [quant-ph] 2017 年 11 月 6 日](/simg/a/a6c3e03439add2bf3b7276875293e2eb7302ac98.webp)

![arXiv:1902.09587v3 [cs.CR] 2020 年 10 月 1 日](/simg/1/17e72fa5b730734f4f251fd870824d19acbc20e2.webp)

![arXiv:1912.05135v3 [cs.CV] 2020 年 3 月 14 日](/simg/0/0707fc16789e4908e2fbb96660f5b652882edfb5.webp)

![arXiv:2112.15422v1 [cs.AI] 2021 年 11 月 25 日](/simg/9/944ac25ddea48b6e4402cdc063b0cba3869af3b5.png)

![arXiv:1611.09099v1 [cs.CV] 2016 年 11 月 28 日](/simg/1/1993bc7fb810e9d0ee2b7ac34d8eb07fb435dedf.webp)

![arXiv:2004.02730v2 [eess.SY] 2020 年 10 月 2 日](/simg/d/daf0cca9d89fed4d586eb67003133c1bb4c4d11e.webp)

![arXiv:2209.00552v2 [eess.SY] 2022 年 11 月 9 日](/simg/a/ad501ca2400f80a04ec171a96cc0f82c991ef29c.webp)